Tensor-Train Decomposition

English version: Tensor-Train Decomposition (EN)

超大規模データを扱うためのテンソル分解技術

― 並列 Tensor-Train Decomposition(TTD)による高速データ圧縮 ―

現代の科学計算やAI、物理シミュレーションでは、多次元配列(テンソル)として表される巨大データを扱うことが増えています。しかしテンソルは次元が増えるとデータ量が指数的に増加する「次元の呪い」に直面し、そのままでは保存や解析が困難になります。これを解決する有力な方法が Tensor Train Decomposition(TTD) です。TTDは多次元データを複数の小さなテンソルに分解することで、必要なパラメータ数を大幅に削減し、効率的にデータを扱えるようにする技術です。しかし従来広く使われているTTDアルゴリズム(TT-SVD)は逐次処理で動作するため、巨大テンソルに対しては計算時間やメモリ消費が非常に大きくなるという課題がありました。特にスーパーコンピュータのような大規模並列環境を十分に活用できないことが問題でした。

そこで本研究では、並列テンソル分解アルゴリズム PTTD(Parallel Tensor Train Decomposition)を提案しました。PTTDでは、巨大テンソルを複数の部分テンソルに分割し、それぞれを独立に分解した後、結果を統合することで全体のTT形式を構築します。さらに統合時には TT-rounding を用いて不要なランクを削減し、効率的なデータ圧縮を実現します。また、計算を高速化するためにQR分解を省略した NOQR-rounding 手法を導入し、計算コストの削減を図りました。

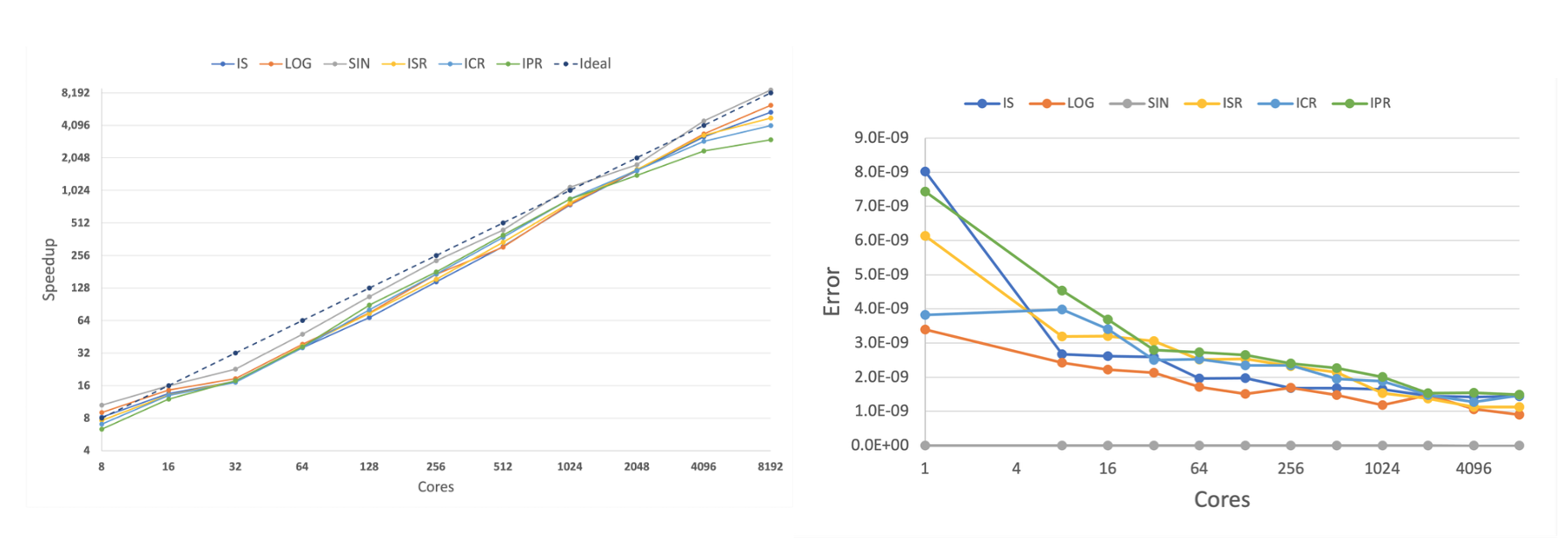

スーパーコンピュータを用いた実験では、本手法は極めて高い並列性能を示しました。最大8192コアを用いた計算では、従来手法に比べて3000〜8700倍以上の高速化を達成し、大規模テンソルでも効率的に分解できることを確認しました。また、近似誤差は理論的に保証された範囲内に収まり、高い圧縮率(99.99%以上)を維持することが示されました。

この研究は、AI、機械学習、科学シミュレーションなどの分野で重要となる超大規模データ解析の基盤技術となるものです。今後はより効率的なアルゴリズムや自動分散戦略を導入することで、さらに大規模なデータ解析への応用を目指しています。

Key publications

- Xie, Shiyao and Miura, Akinori and Ono, Kenji, Error-bounded Scalable Parallel Tensor Train Decomposition, 2023 IEEE International Parallel and Distributed Processing Symposium Workshops (IPDPSW), 2023.